Die Lösung: RAG als Anker an die Realität

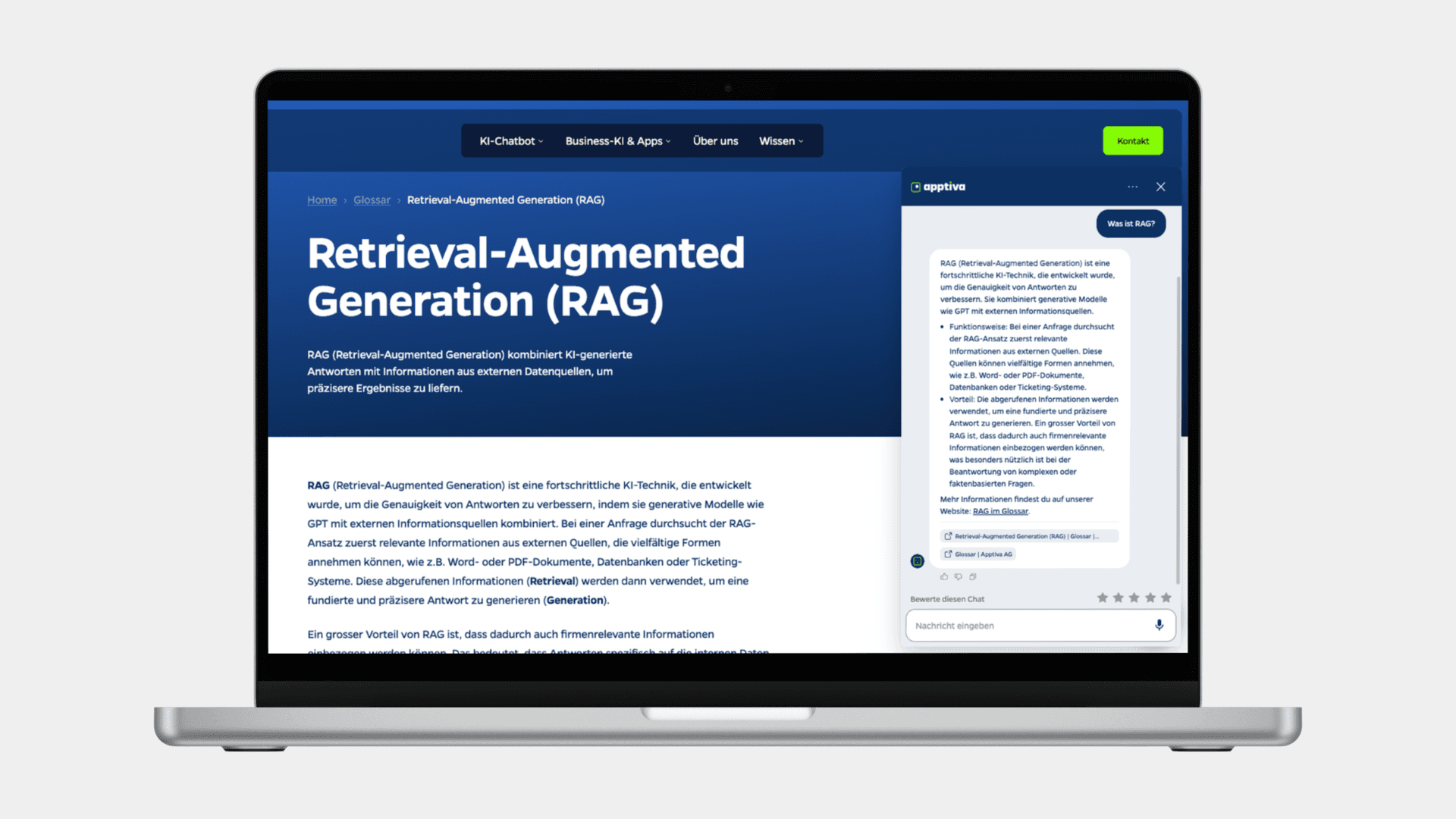

Um Halluzinationen zu verhindern, setzen wir bei der Apptiva auf Retrieval-Augmented Generation (RAG). Damit wird Bubble Chat von einer plaudernden KI zu einem präzisen Spezialisten, der jede Aussage belegen kann.

RAG ist wie eine «Open-Book-Prüfung» für die KI: Anstatt dass der Chatbot versucht, Antworten aus seinem allgemeinen (und oft veralteten) Training auswendig aufzusagen, darf er bei jeder Frage zuerst in deinen spezifischen Dokumenten nachschlagen. Er sucht die passenden Stellen heraus und formuliert dann eine Antwort aufgrund dieser Quellen. So fungiert das Modell als intelligentes Interface für deine validierten Datenquellen, anstatt Fakten frei zu erfinden.

Das Halluzinations-Problem: Wenn Kreativität zum Risiko wird

Herkömmliche Sprachmodelle (LLMs) sind darauf trainiert, das nächste wahrscheinliche Wort vorherzusagen. Fehlen ihnen spezifische Informationen über deine Produkte oder Prozesse, füllen sie diese Lücke oft mit erfundenen Details, die täuschend echt klingen.

Im geschäftlichen Kontext führt dies zu:

- Falschen Auskünften: Irreführende Preise oder Konditionen.

- Produktfehlern: Nicht existierende Eigenschaften werden versprochen.

- Rechtlichen Risiken: Haftungsfragen durch fehlerhafte automatisierte Beratung.

So erzwingt Bubble Chat Faktentreue:

- Gezielte Suche: Bei jeder Anfrage durchsucht das System zuerst deine spezifische Wissensdatenbank (z. B. Webseiten, Handbücher oder Schnittstellen-Daten).

- Kontext-Zwang: Das Sprachmodell erhält den strikten Befehl, die Antwort nur auf Basis der gefundenen Textstellen zu formulieren.

- Belegbarkeit (Citations): Jede Antwort wird mit Quellenangaben versehen. Du siehst sofort, auf welches Dokument sich die KI bezieht.

Warum Sicherheit und Compliance hier Hand in Hand gehen

Ein häufiges Missverständnis ist, dass die Nutzung von Daten für Antworten die Sicherheit gefährdet. Tatsächlich ist das Gegenteil der Fall:

- Daten-Isolation: Deine Dokumente werden nicht für das Training öffentlicher Modelle verwendet. Sie bleiben in deiner geschützten Umgebung.

- Validierte Antworten: Jede Antwort wird gegen deine eigene Wissensdatenbank geprüft. Das stellt sicher, dass die KI keine Informationen halluziniert.

- Audit-Fähigkeit: Da jede Antwort auf einer Quelle basiert, bleibt die Kommunikation deines Chatbots jederzeit überprüfbar und compliant mit deinen Unternehmensrichtlinien.

Vom Bot zum verlässlichen KI-Agenten

Die Eliminierung von Halluzinationen ist die Grundvoraussetzung, um den nächsten Schritt zu gehen: KI-Agenten. Nur wenn ein System faktentreu arbeitet, kannst du ihm zutrauen, eigenständig Prozesse anzustossen oder komplexe Aufgaben in Drittsystemen zu übernehmen.

Setze auf belegbare Intelligenz

Überlasse die Kommunikation mit deinen Kunden nicht dem Zufall oder der Fantasie einer KI. Mit Bubble Chat nutzt du die Power von Generative AI, fest verankert in deinen Fakten.

Erfahre mehr über unsere KI-Lösungen oder kontaktiere uns für eine Demo.